Resumen

Redes más complejas (mayor cantidad de capas y nodos) solucionan problemas más complejos. Se recomienda empezar con pocas neuronas y capas ocultas e ir aumentando el número hasta conseguir métricas deseadas.

Funciones de activación

La función de activación es la forma a través de la cual, las neuronas artificiales procesan la información y esta se distribuye por la red. La señal de entrada pasa por la función de activación

y si supera un umbral determinado la señal atraviesa la neurona. Dicho umbral es conocido como threshold activation function.

A continuación, veremos algunas funciones de activación:

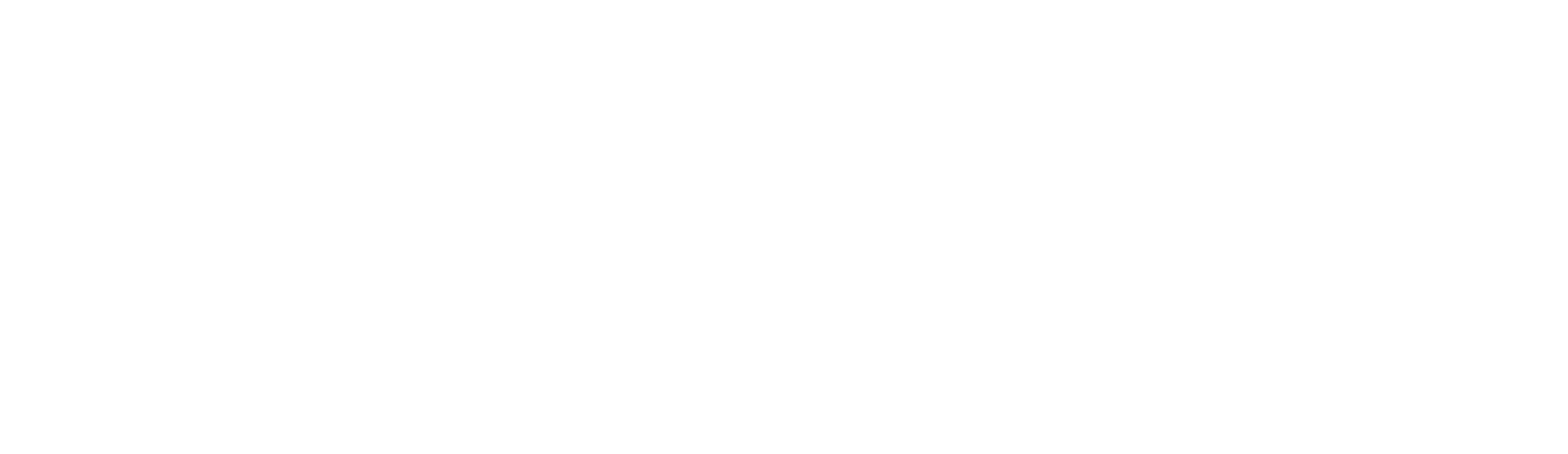

Función de activación Unitaria

Se activa cuando la suma de la señal de entrada es > 0, en este caso el umbral es 0.

Imagen tomada de: Fuente: Brett, 2013

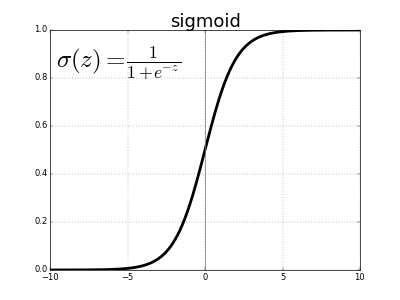

Sigmoide

Es la función de activación más utilizada, gracias a que es diferenciable y simplifica el proceso de entrenamiento de la red.

Imagen tomada de:

https://ml4a.github.io/ml4a/es/neural_networks/

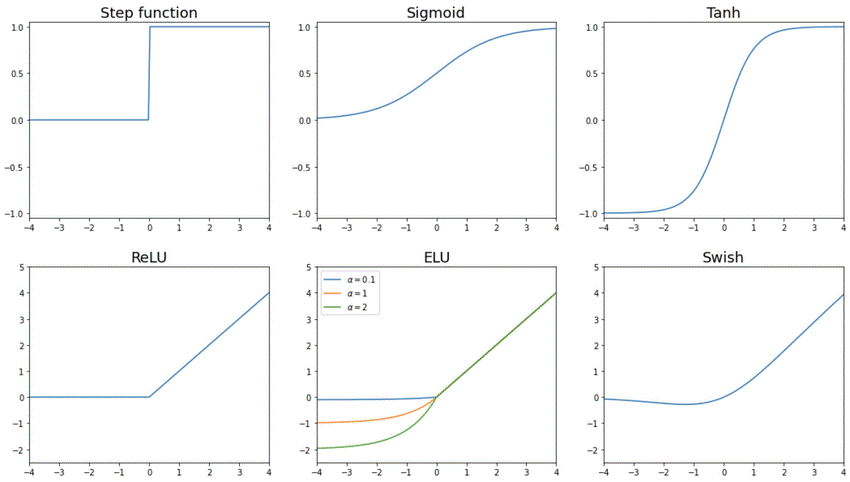

Otras funciones de activación comunes.

Imagen tomada de:

https://www.researchgate.net/figure/The-most-popular-activation-functions-for-neural-networks-The-step-function-was_fig8_358458290

La principal diferencia entre las funciones de activación anteriores es el rango de la señal de salida, el cual puede variar entre (0, 1), (-1, +1) y (-inf, +inf).

Es importante definir correctamente la función de activación porque esta le permite a la red manipular mejor ciertos tipos de datos.